Nuestras conversaciones con Claude fueron intocables. Hoy la urgencia de las prensas de datos para hacerles materias primas de la IA – El diario andino

Por lo general, hablamos con la inteligencia artificial como si fuera una persona más y, a veces, confiamos en información muy personal. Sin embargo, rara vez nos detenemos a pensar en lo que sucede con esas conversaciones. Hasta ahora, el estándar en buena parte del sector había sido usarlos para entrenar modelos, a menos que el usuario se opuso. Anthrope representó una excepción: Claude tenía una política explícita de no usar las conversaciones de sus clientes privados para este propósito. Esa excepción acaba de romper. La razón es directa y contundente: los datos son la materia prima de la IA.

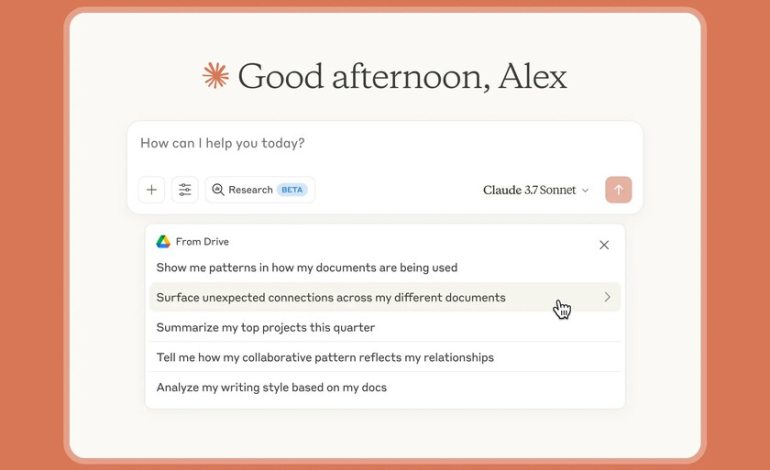

Anthrope acaba de anunciar en su blog oficial Una actualización de sus condiciones de servicio para los consumidores y su política de privacidad. Los usuarios de los planes Free, Pro y Max, incluidas las sesiones en el Código Claude, deben aceptar o rechazar explícitamente que sus conversaciones se usen para la capacitación de modelos futuros. La compañía estableció la fecha límite hasta el 28 de septiembre de 2025 y advirtió que, después de esa fecha, será necesario elegir la preferencia para continuar usando Claude.

El giro antrópico. La modificación no afecta a todos igualmente: los servicios sujetos a términos comerciales se dejan fuera, como Claude for Work, Claude Gov, Claude for Education o Access por API a terceros como Amazon Bedrock o Vertex Ai de Google Cloud. Anthrope afirma que la nueva configuración solo se aplicará a los chats y las sesiones de código iniciadas o retomados después de aceptar las condiciones, y que las conversaciones antiguas sin actividad adicional no se utilizarán para entrenar modelos. Es una distinción operativa relevante: el cambio actúa sobre la actividad futura.

¿Por qué este cambio? Anthrope señala que todos los modelos de lenguaje «entrenan utilizando grandes cantidades de datos» y que las interacciones reales ofrecen señales valiosas para mejorar las capacidades, como el razonamiento o la corrección del código. Al mismo tiempo, varios especialistas han señalado un problema estructural: el sitio web abierto se está agotando como una fuente de información fresca y de fácil acceso, de modo que las empresas buscan nuevas rutas de datos para mantener la mejora continua de los modelos. En ese contexto, las conversaciones de los usuarios adquieren valor estratégico.

Aunque Anthrope enfatiza la seguridad (mejorar Claude y reforzar las salvaguardas contra usos dañinos, como estafas y abusos), la decisión probablemente también responde a la competencia: OpenAi y Google siguen siendo referencias en el campo y requieren grandes volúmenes de interacción para avanzar. Sin suficientes datos, las distancias en la carrera de IA que estamos presenciando en vivo pueden aumentar.

Cinco años en lugar de treinta días. Junto al permiso de capacitación, Anthrope ha ampliado el período de retención para datos compartidos para fines de mejora: cinco años si el usuario acepta participaren comparación con los 30 días que gobiernan si esa opción no está activada. La compañía también especifica que los chats eliminados no se incluirán en la capacitación futura y que el comentario El enviado también se puede mantener. También establece que combina procesos y herramientas automatizados para filtrar u ofuscar información confidencial que no vende datos de usuario a terceros.

Imágenes | Claude | Captura de pantalla

En | Microsoft prefiere su propio 7 que un 10 de OpenAi. Los 13,000 millones invertidos en OpenAi tienen un significado de Gosses